Minister Cyfryzacji Dariusz Standerski wywołał spore poruszenie, mówiąc, że nie wyklucza wyłączenia platformy X, jeśli

jej modele AI będą łamać zasady etyczne. Dla wielu to przesada, lecz dla mnie jest to zupełnie zrozumiała reakcja. Jeśli

gigantyczna korporacja tworzy system, który nie ponosi żadnej realnej prawnej odpowiedzialności za publikowane treści,

to groźba wyłączenia usługi wydaje się jedyną realną dźwignią, jaką państwo w ogóle jeszcze ma.

Bo jak inaczej pociągnąć do odpowiedzialności kogoś, kto nie istnieje prawnie, a rozsyła pomówienia, szerzy

dezinformację i gloryfikuje zbrodniarzy? Jasne, właściciel X formalnie istnieje – ale w praktyce pozywanie go z Polski

to jak strzelanie z procy w pancernik. Pozwy o naruszenia dóbr osobistych są skrajnie nieskuteczne, przewlekłe, a

skutki, jeśli w ogóle są, to są czysto symboliczne, szczególnie w porównaniu do zysku korporacji.

Co nam umyka - Grok nie opiera się tylko na faktach: on uczy się przede wszystkim z reakcji użytkowników platformy,

czyli z ich opinii, teorii i emocji. Często powtarza rzeczy nieprawdziwe, które po prostu zebrały lajki. A my? Coraz

częściej bezrefleksyjnie ufamy każdemu zdaniu generowanemu przez AI, nie weryfikując źródeł ani intencji.

Problemem nie jest jedynie AI samo w sobie i Grok. Znani politycy i ich armie botów robią to samo każdego dnia, również

bez konsekwencji. Narzędzia umożliwiające dotarcie do oryginalnych twórców posługujących się armiami trolli istnieją,

ale nie ma woli politycznej, by przeciwdziałać fali hejtu i dezinformacji szerzonej z tych fałszywych kont.

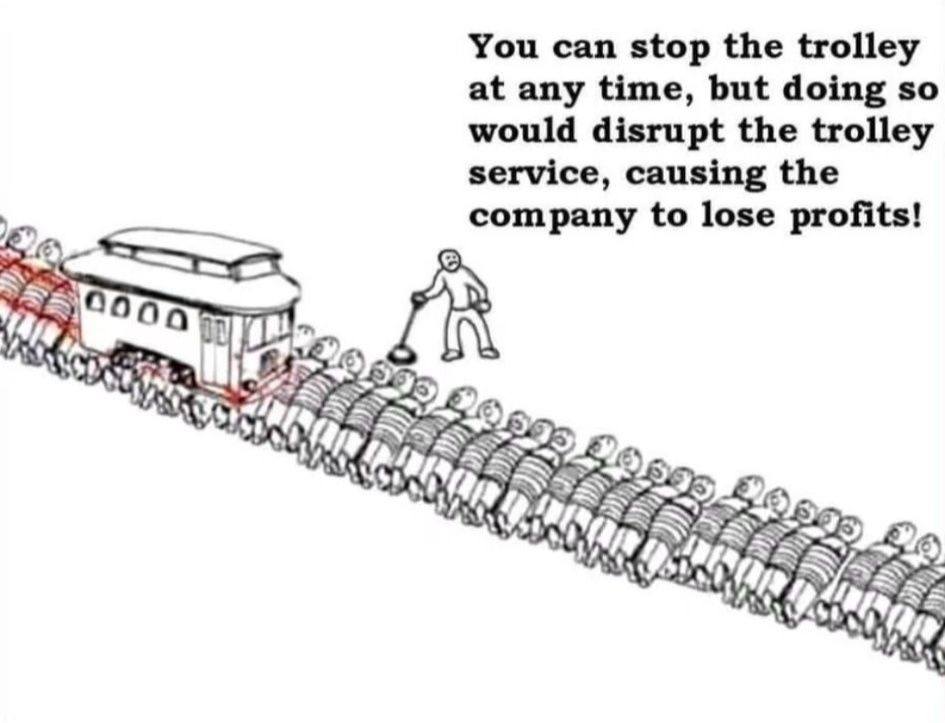

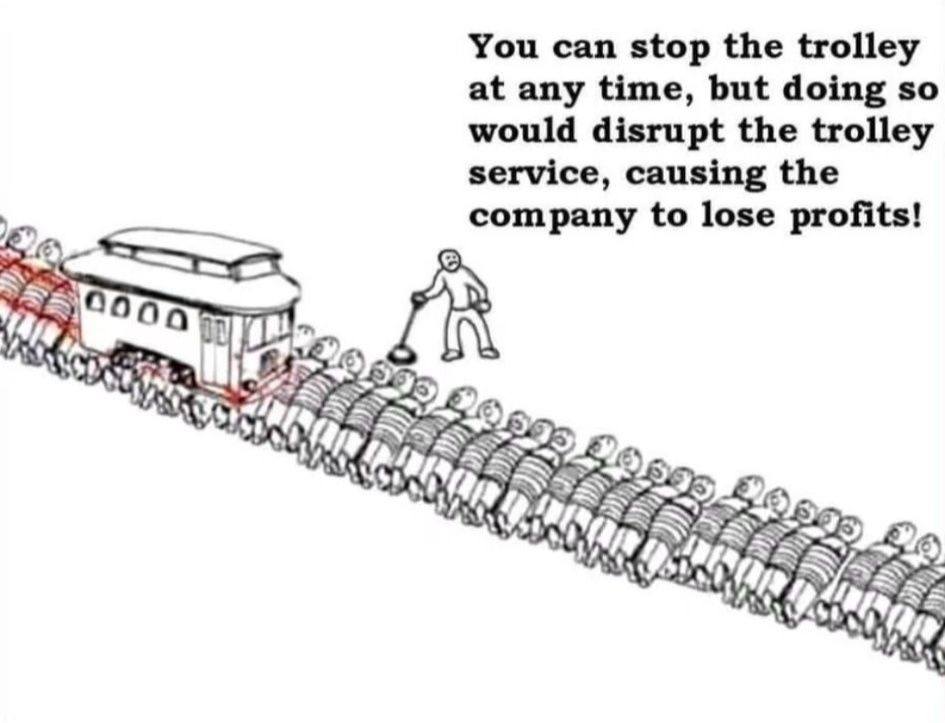

Potem wchodzą wielcy piewcy wolności słowa sugerując, że nie powinniśmy uciszać ludzi (i botów), bo święta wolność jest

najważniejsza. Ci ludzie zapominają, że wolność musi iść w parze z odpowiedzialnością - niezależnie od tego, czy treść

pisze człowiek, czy maszyna, zawsze ktoś powinien za nią odpowiadać, a odpowiedzialność korporacji jest rozmyta i

realnie żadna.